Depressione e ansia sono i mali del millennio, problemi che sempre più spesso spingono le persone a cercare aiuto nell’intelligenza artificiale. Non a caso, nel corso del 2025, le applicazioni basate su intelligenza artificiale dedicate alla salute mentale hanno conosciuto una diffusione senza precedenti. Piattaforme come Woebot, Replika o Wysa promettono supporto psicologico immediato, accessibile 24 ore su 24. Eppure, dietro questa apparente comodità, si nasconde un rischio importante: pensare che basti un algoritmo per curare disagi emotivi e mentali, senza il confronto con un professionista.

Chi di noi prenderebbe si farebbe operare, ammesso che fosse possibile, per una diagnosi ottenuta da una IA? Ansia, depressione, traumi sono condizioni delicate che richiedono sempre una valutazione personalizzata, empatica e in profondità

I limiti dell’intelligenza artificiale nella cura della psiche

Molti strumenti digitali si basano su modelli di terapia cognitivo-comportamentale, capaci di fornire suggerimenti standard o esercizi di rilassamento. Tuttavia:

- Mancanza di ascolto vero: un chatbot non può cogliere sfumature come l’intonazione della voce, i silenzi, le emozioni non dette.

- Rischio di peggioramento: affidarsi esclusivamente a un’app può ritardare l’accesso a un aiuto professionale, aggravando il problema.

- Personalizzazione limitata: ogni essere umano ha una storia unica. L’IA si basa su modelli generici che non tengono conto di traumi pregressi, contesto familiare o culturale.

- Dipendenza emotiva dalla macchina: è già stato osservato in alcuni utenti il rischio di sviluppare un attaccamento eccessivo al proprio chatbot, percepito quasi come un amico reale, con effetti ambigui sul benessere psichico.

Psicologi e psichiatri: una presenza insostituibile

Gli esperti sono unanimi: l’intelligenza artificiale può offrire un primo livello di supporto, ma non potrà mai sostituire psicologi, psicoterapeuti o psichiatri. Il motivo è semplice, la cura della mente passa attraverso la relazione umana. Solo un terapeuta può sostenere il paziente con ascolto attivo e comprensione empatica; riformulare pensieri e schemi disfunzionali in modo dinamico, adattandosi al percorso individuale; intervenire in situazioni di emergenza (pensieri suicidari, crisi acute) eprescrivere eventualmente farmaci in maniera appropriata, laddove necessario.

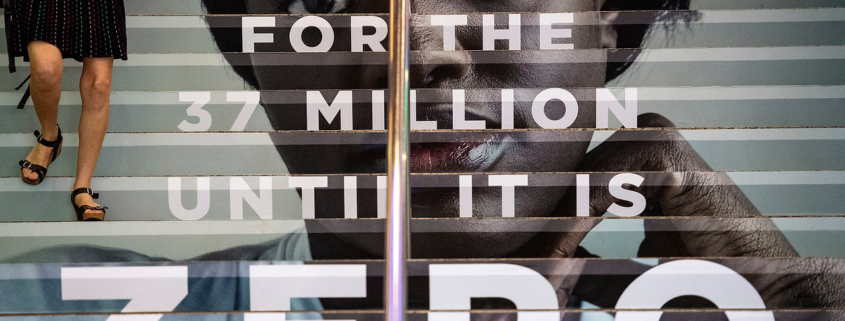

Depressione e ansia, la posizione degli organismi internazionali

Anche l’Organizzazione Mondiale della Sanità (OMS) e il Consiglio d’Europa hanno chiarito il concetto: l’IA può rappresentare uno strumento di supporto nella salute mentale, ma solo come complemento alla figura umana del terapeuta.

In particolare, nel documento WHO Digital Health Guidelines 2025, si raccomanda:

-

Uso controllato e supervisionato delle app IA per la salute mentale;

-

Validazione scientifica continua degli strumenti digitali;

-

Obbligo di segnalazione dei limiti e delle avvertenze d’uso agli utenti.

Un messaggio chiaro per chi soffre

Se si avvertono sintomi come tristezza persistente, ansia, insonnia, pensieri ricorrenti o senso di vuoto, la prima azione deve essere quella di parlarne con il proprio medico. Sarà lui a consigliare, se necessario, di rivolgersi ad uno specialista. Per quanto, spesso, con grandi carenze il Sistema sanitario pubblico offre centri dedicati di supporto, i Centri di Salute Mentale.

Utilizzare un’app o un chatbot può servire, al massimo, come primo orientamento o come sostegno temporaneo. Ma nessuna tecnologia può prendersi cura davvero di ciò che ci rende umani: pensieri, emozioni, fragilità e desideri.

Più consapevolezza, meno automatismi

L’intelligenza artificiale è uno strumento potente, ma deve essere usata con criterio e consapevolezza. In salute mentale, il rischio di semplificare eccessivamente le cure è troppo alto per essere ignorato. “Dietro ogni sofferenza c’è una storia, non un algoritmo”

Leggi anche:

it freepik

it freepik